反向传播实际上就是在算各个阶段梯度,每层的传入实际是之前各层根据链式法则梯度相乘的结果。反向传播最初传入的Δout是1,Δ通常表示很少量的意思,Δout=1的时候这样在反向传播的时候算出来的dw和dx刚好就是当前梯度。深度神经网络中每层都会记录正向传播时该层传入的x,就是为了反向传播的时候计算dw的时候用到。反向传播的时候也会利用w计算出dx来作为下一层的反向传播的输入。反向传播时每层的输入都是前几层梯度相乘的结果(链式法则),每层的输出也应该是本层梯度乘以输入的结果(链式法则),需要注意的是计算MatMul节点的反向传播时要注意矩阵形状,所以需要矩阵转置。反向传播计算的各种梯度就是为了梯度下降做准备工作。

梯度下降的时候代码如下:

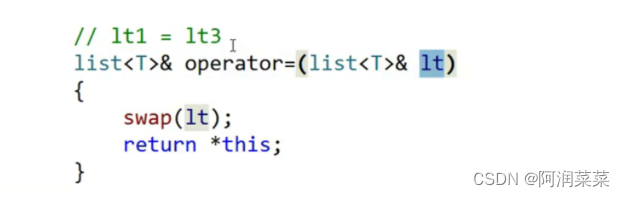

class SGD:

def __init__(self, lr=0.01):

self.lr = lr

def update(self, params, grads):

for i in range(len(params)):

params[i] -= self.lr * grads[i]

params 是每层神经网络的w和b,grads 对应的是各层参数的梯度。 params[i] -= self.lr * grads[i] 表示每层的w和b都要梯度下降,这是因为反向传播的时候,每层的梯度都是损失函数f_loss(x)对x的导数的一部分,根据链式法则,因为链式法则是相乘关系所以每个因子梯度下降总体梯度也是下降的。

代码来源《深度学习进阶-自然语言处理》第一章